LangChain est une bibliothèque open-source conçue pour faciliter le développement d'applications utilisant des modèles de langage. En combinant des modèles de langage comme GPT avec des sources de données externes, des APIs ou des workflows personnalisés, LangChain permet de créer des applications conversationnelles plus puissantes, adaptatives et dynamiques. Son architecture modulaire permet de construire des agents capables de suivre des raisonnements complexes et d’intégrer diverses informations en temps réel, ce qui est idéal pour des cas d’usage tels que les assistants virtuels avancés, les systèmes de recommandation ou l'automatisation de tâches.

Qu’est-ce que LangChain ?

LangChain a révolutionné la manière dont les développeurs créent et gèrent des chaînes de traitement de modèles de langage (LLMs). En offrant une structure modulaire, LangChain permet de construire des applications d’IA combinant plusieurs modèles de langage. Cette flexibilité permet de répondre aux besoins variés des projets modernes, tout en étant à la fois performant et évolutif.

Principales caractéristiques

LangChain offre plusieurs avantages clés pour les développeurs :

- Modularité : Combinez différents composants de traitement de texte, tels que la génération, la classification ou l’analyse de sentiment, dans une chaîne unique.

- Intégration facile : Intégration fluide avec des services tiers comme OpenAI, Hugging Face ou d’autres plateformes de traitement du langage naturel.

- Extensibilité : Ajoutez vos propres modèles ou composants personnalisés pour répondre aux besoins uniques de chaque projet.

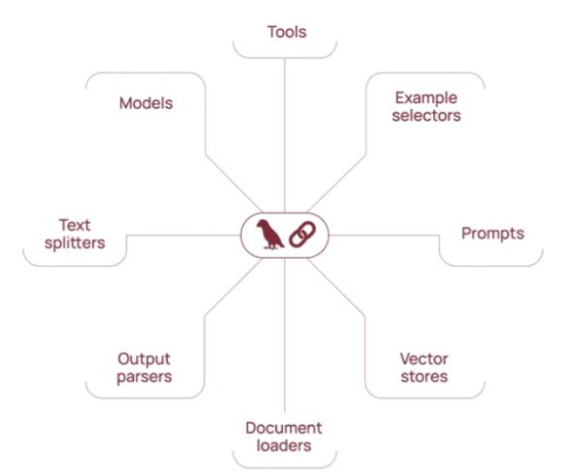

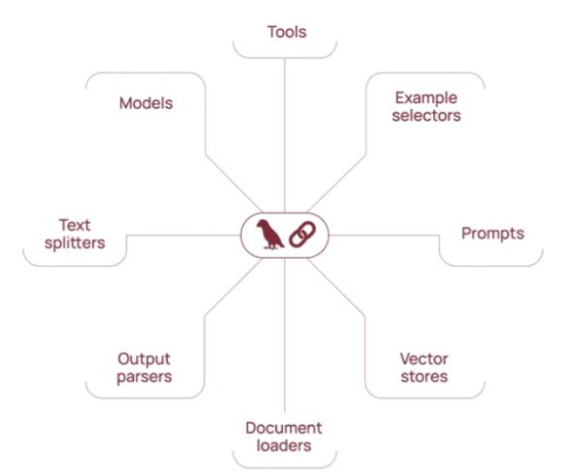

Modules clés

LangChain est organisé autour de modules principaux, chacun jouant un rôle spécifique dans la gestion des flux de travail basés sur des modèles de langage :

- Modèles de langage (LLMs) : Fournit une interface générique pour interagir avec divers modèles de langage.

- Prompts : Gère et optimise les invites pour les modèles de langage.

- Chargeurs de documents : Charge des données à partir de sources variées.

- Utilitaires : Connecte les modèles de langage à d’autres sources de connaissance ou outils.

- Chaînes (Chains) : Crée des flux de travail complexes en séquencant différentes actions.

- Agents : Permet une prise de décision autonome par les modèles, basée sur l’interaction avec d’autres outils.

- Mémoire : Maintient le contexte à travers plusieurs appels ou interactions, essentiel pour des applications conversationnelles complexes.

Premiers pas avec LangChain

Installation

Avant de commencer, installez LangChain et les dépendances nécessaires. Si vous utilisez OpenAI ou des services compatibles, utilisez la commande suivante :

Exemple d’implémentation

Pour mieux comprendre comment utiliser LangChain, voici un exemple simple utilisant un modèle LLM fournissant des réponses à une question précise. Dans cet exemple, nous utilisons un modèle fourni par

Groq, qui est compatible avec l’API OpenAI.

Dans cet exemple :

- Nous initialisons un modèle LangChain compatible avec un modèle Groq.

- Nous définissons une question pour le modèle.

- Le modèle est appelé pour générer une réponse.

- La réponse est affichée sous forme de texte.

Utilisation des prompts

Les prompts jouent un rôle crucial dans les interactions avec les modèles de langage. LangChain facilite la gestion et la personnalisation des prompts à l'aide de structures dédiées comme le PromptTemplate. Voici un exemple d'utilisation :

Dans cet exemple :

- Création du template : Nous définissons un template de prompt avec un paramètre

{color} - Personnalisation dynamique : La méthode

format remplace le paramètre par une valeur donnée (ici, "bleu"). - Utilisation finale : Le prompt généré peut ensuite être utilisé avec un modèle pour obtenir une réponse spécifique.

Cette approche offre une grande flexibilité pour générer des prompts adaptés à différents cas d’usage, ce qui améliore considérablement les résultats des modèles de langage.

Prompt + Model

En combinant l’utilisation des modèles et des prompts, vous pouvez encapsuler cette logique dans une fonction réutilisable. Voici un exemple :

Détails de l’implémentation :

- Fonction générique : La fonction

getanimalsfrom_color encapsule la logique pour être réutilisable avec n’importe quelle couleur. - Prompt dynamique : Le prompt est généré en remplaçant dynamiquement la couleur fournie en argument.

- Traitement de la réponse : La réponse du modèle est supposée être une liste d’animaux séparés par des virgules, facilement transformable en une liste Python.

Ce type de fonction peut être intégré dans des applications plus complexes pour enrichir les fonctionnalités conversationnelles ou génératives.

Conclusion

LangChain s’impose comme une boîte à outils indispensable pour les chercheurs et développeurs explorant les possibilités des modèles de langage. Grâce à sa modularité, ses outils pour la gestion des prompts, et sa capacité à interagir avec des données externes, LangChain ouvre des perspectives prometteuses pour l’intégration de l’IA générative dans des projets de recherche avancée. Que vous souhaitiez créer des agents intelligents ou automatiser des processus complexes, LangChain fournit les bases nécessaires pour construire des solutions robustes et évolutives.