La génération augmentée par récupération (RAG) révolutionne l'IA moderne en permettant aux modèles de langage avancés (LLM) d'intégrer des connaissances externes pour des réponses plus pertinentes et précises. Cependant, son processus traditionnel, basé sur une récupération en temps réel, peut entraîner des délais et une certaine complexité. Pour y remédier, la génération augmentée par cache (CAG) propose une approche innovante : intégrer directement les connaissances nécessaires dans le contexte du modèle, éliminant ainsi la phase de récupération en temps réel. Cet article explore et compare ces deux approches, en analysant leurs avantages, leurs limites et leurs usages possibles.

Rappel : La génération augmentée par récupération - RAG (Retrieval-Augmented Generation)

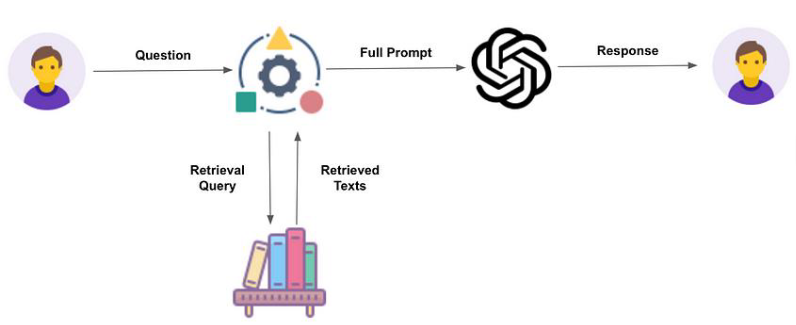

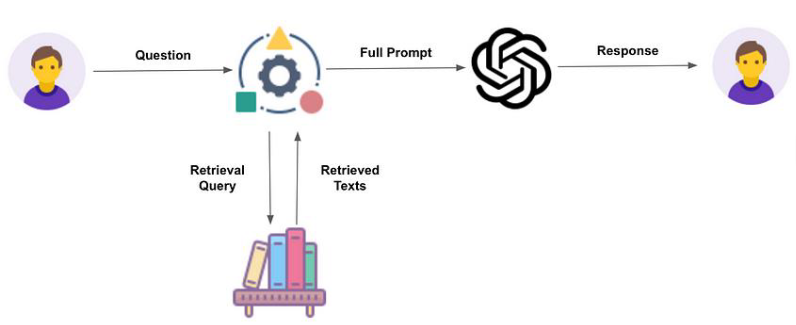

Le RAG repose sur une étape de récupération en temps réel pour intégrer des connaissances externes aux réponses des LLM. À chaque requête utilisateur, le système recherche des documents pertinents dans une base de connaissances et les intègre au prompt avant de générer une réponse.

Avantages :

- Données Actualisées : Permet d’accéder à des informations récentes et dynamiques.

- Légèreté du Modèle : Le stockage des connaissances dans une source externe allège le modèle.

- Réduction des Hallucinations : Les réponses sont basées sur des documents réels.

Inconvénients :

- Latence : La récupération en temps réel peut ralentir les réponses.

- Complexité Systémique : Maintenir une base de données actualisée est coûteux.

- Erreurs de Récupération : Des documents non pertinents peuvent être sélectionnés.

Exemple :

Un service client virtuel pour une boutique en ligne utiliserait le RAG pour fournir des réponses précises aux questions des clients concernant les stocks actuels ou les délais de livraison.

Par exemple, un utilisateur demandant : « Cet article est-il encore disponible en taille M et combien de temps prendra la livraison ? » verrait le système :

- Analyser la requête.

- Récupérer les documents pertinents dans la base de connaissances en temps réel.

- Générer une réponse basée sur les informations récupérées.

Une Approche Innovante : La génération augmentée par cache - CAG (Cache-Augmented Generation)

Le CAG réinvente le paradigme en préchargeant les informations pertinentes dans le contexte étendu des LLM, éliminant le besoin de récupération dynamique.

Fonctionnement :

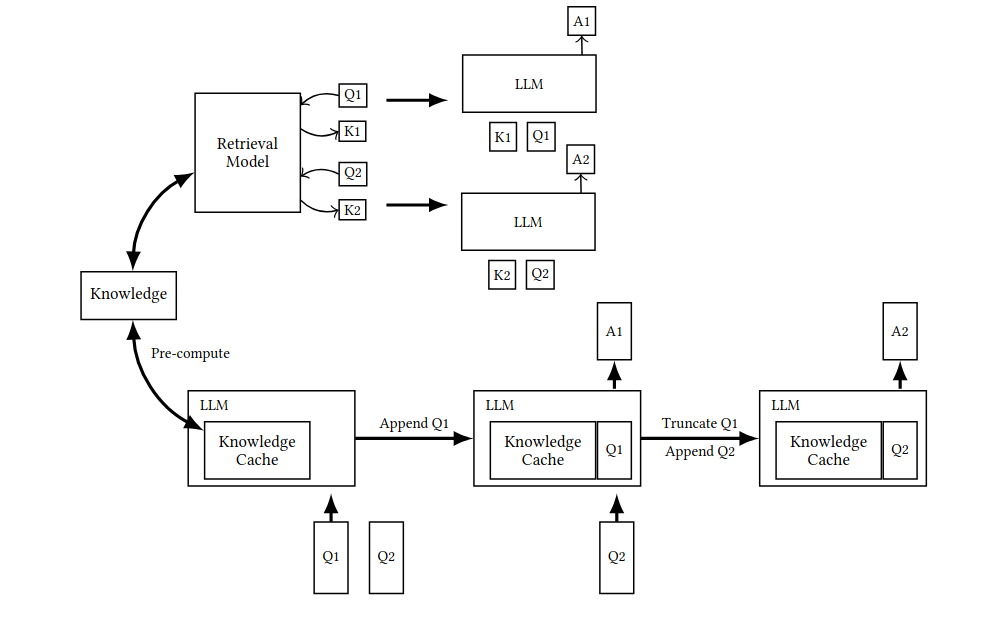

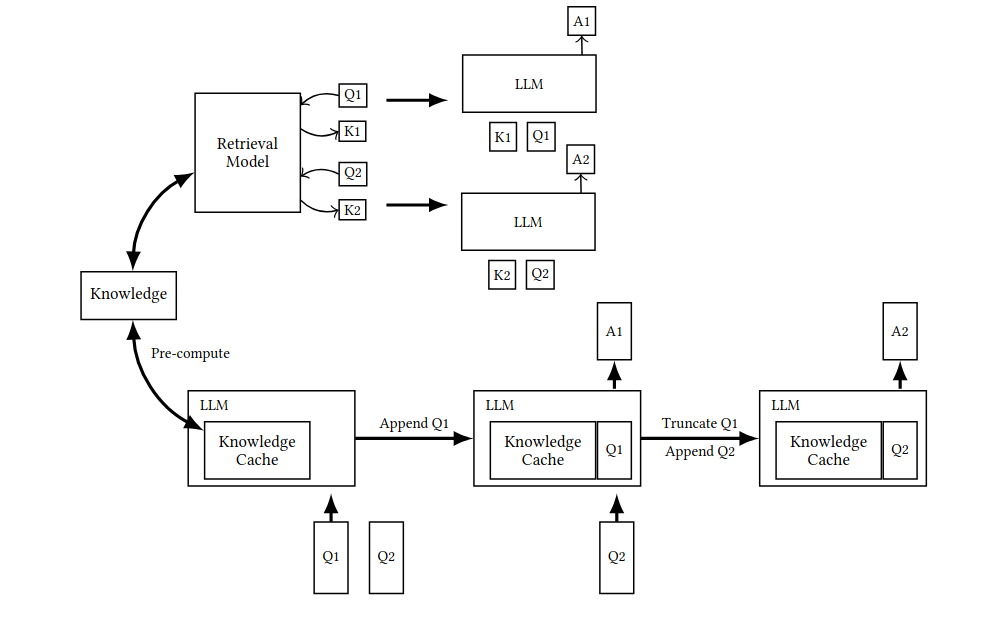

- Prétraitement : Les connaissances nécessaires sont identifiées et organisées avant l’utilisation.

- Mise en Cache : Les données prétraitées sont intégrées directement dans la mémoire du modèle lors de son initialisation.

- Utilisation : Lorsque l’utilisateur pose une question, le modèle accède à ces données déjà préchargées pour fournir une réponse rapide et précise.

Le schéma ci-dessus illustre la comparaison des flux de travail traditionnels RAG et de la méthode CAG : La section supérieure illustre le pipeline RAG, incluant la récupération en temps réel et l'entrée de texte de référence pendant l'inférence, tandis que la section inférieure présente notre approche CAG, qui précharge le KV-cache, éliminant ainsi l'étape de récupération et l'entrée de texte de référence lors de l'inférence.

Avantages :

- Temps de Réponse Accéléré : Absence de délai lié à la récupération.

- Simplicité Architecturale : Réduction de la complexité opérationnelle.

- Cohérence des Réponses : Utilisation d’un contexte fixe pour des réponses uniformes.

- Efficacité : Moindre charge de calcul grâce à l’évitement des étapes redondantes de récupération.

Limites :

- Fenêtre de Contexte Limitée : Impossible de précharger de grandes bases de connaissances.

- Données Statiques : Peu adapté aux environnements dynamiques.

- Coûts Initiaux : Les ressources nécessaires pour la préparation des caches sont élevées.

Exemple :

Une plateforme d’apprentissage pourrait précharger des modules d’enseignement pour des cours spécifiques.

Si un étudiant demande : « Quels sont les concepts clés du calcul différentiel ? », le système :

- Accède aux ressources éducatives préchargées.

- Propose une explication structurée et immédiate, incluant des exemples pratiques.

RAG vs. CAG : Un Duel Contextuel

| Caractéristique | Retrieval-Augmented Generation (RAG) | Cache-Augmented Generation (CAG) |

|---|

| Récupération | Effectuée en temps réel pour chaque requête | Chargée au préalable lors de l'initialisation |

| Contexte | Obtenu de manière dynamique | Fixe et stocké en cache |

| Connaissance | Accès à un large éventail de sources | Restreinte par la capacité de la fenêtre de contexte |

| Vitesse | Plus lent à cause des étapes de récupération | Plus rapide grâce aux données déjà chargées |

| Complexité | Processus complexe en raison des étapes de récupération | Plus simple grâce à un flux de travail optimisé |

| Scalabilité | Très élevée, sans limite liée au contexte | Dépendante de la taille de la fenêtre de contexte |

| Coût | Souvent moins onéreux | Peut entraîner des coûts plus élevés |

Quelle approche choisir ?

Utiliser le RAG lorsque :

- Vous travaillez avec des bases de connaissances volumineuses.

- Vous gérez des contenus en constante évolution.

- Vos requêtes sont variées et imprévisibles.

- La précision des réponses est une priorité absolue.

Utiliser le CAG lorsque :

- Les connaissances nécessaires sont limitées et bien définies.

- Les requêtes similaires se répètent fréquemment.

- La vitesse de réponse est cruciale pour l’application.

- Les données utilisées sont stables et rarement mises à jour.

Vers une Approche Hybride ?

Le RAG et le CAG offrent des avantages et des inconvénients distincts. Le choix entre ces deux approches dépend fortement des besoins spécifiques de l'application. Le RAG est idéal pour les cas où un accès en temps réel aux données et une grande flexibilité sont nécessaires. En revanche, le CAG est mieux adapté aux applications où la rapidité est cruciale et où les domaines de connaissances sont bien définis. À l'avenir, des solutions hybrides combinant ces deux approches pourraient émerger comme des options optimales. Ces solutions pourraient exploiter les informations mises en cache pour les requêtes fréquentes tout en utilisant la récupération dynamique pour des besoins de connaissances plus variés, permettant ainsi de répondre efficacement à des demandes diversifiées.

L'intérêt des solutions hybrides

Les approches hybrides, qui réunissent les points forts du RAG et du CAG, pourraient offrir un compromis puissant :

- Rapidité et fiabilité : L'utilisation de données mises en cache pour des requêtes récurrentes garantit des réponses rapides et stables.

- Souplesse et extensibilité : Le recours au RAG permet de traiter un éventail de requêtes plus large et de s'adapter à des besoins de connaissances évolutifs.

- Optimisation des requêtes fréquentes : Le CAG peut gérer efficacement des données statiques souvent consultées grâce à sa faible latence.

- Gestion des requêtes dynamiques : Le RAG reste incontournable pour des recherches plus imprévisibles nécessitant des mises à jour en temps réel.

Conlusion

Le CAG constitue une alternative intéressante au RAG traditionnel en réduisant la latence liée à la récupération des données, au prix d'une contrainte : une fenêtre de contexte limitée. Cette méthode privilégie une gestion plus efficace des connaissances en s'appuyant sur la capacité des LLM à traiter directement les informations en mémoire. Le choix entre ces deux approches dépendra de vos besoins spécifiques, de la taille de votre base de connaissances et du niveau de dynamisme des données que vous devez consulter. Avec les progrès constants des LLM, il est probable que les solutions les plus performantes combinent les avantages des deux approches. Une compréhension approfondie de leurs particularités respectives est cruciale pour développer des systèmes intelligents capables de répondre aux exigences actuelles et futures.