Formations

9 mois

Mastère Modern Data Engineer

Construisez des pipelines de données robustes, scalables et prêts pour la production. Devenez un ingénieur data capable de concevoir, déployer et industrialiser des architectures modernes cloud & Big Data.

🇫🇷

Les Agents IA : La vrai révolution des LLM

Table de matières

Vue d’ensemble des agents

Outils et technologies utilisés par les agents IA

Vue d’ensemble de la planification

Les modèles fondationnels en tant que planificateurs

Différences entre planificateurs basés sur modèles fondationnels (FM) et apprentissage par renforcement (RL)

Génération de plans

Choisir les bons outils pour un agent IA

Conclusion : L'essor des agents IA autonomes

Partager avec

Vue d’ensemble des agents

- Perception : Un agent doit être capable de percevoir son environnement et comprendre les signaux et les données que cet environnement lui transmet.

- Plannification : En se basant sur son environnement et l'objectif donné, un agent doit être capable de plannifier un ensemble d'étapes à effectuer et tester sur son environnement pour atteindre cet objtecif.

- Action : Un agent doit être capable d'utiliser des outils (function call dans le cadre des LLM) pour agir sur son environnement et effectuer les tâches et étapes plannifiées.

Environnement et actions des agents IA

- Si un agent est développé pour jouer à un jeu (ex. : Minecraft, Go, Dota), ce jeu constitue son environnement.

- Si un agent est conçu pour extraire des documents sur Internet, son environnement est le web.

- Si un agent est une voiture autonome, son environnement est le système routier et ses alentours.

- ChatGPT a évolué depuis sa sortie pour devenir plus agentic. Il peut maintenant rechercher sur le web, exécuter du code Python et générer des images.

- Certains systèmes RAG (Retrieval-Augmented Generation) sont agentics – leurs outils incluent des récupérateurs de texte, des récupérateurs d’images et des exécuteurs SQL.

Exemple : Un agent de codage

- Naviguer dans un répertoire

- Rechercher des fichiers

- Consulter des fichiers

- Modifier du code

Outils et technologies utilisés par les agents IA

1. Outils d'augmentation des connaissances

- Moteurs de recherche de texte et d'images : Ces outils permettent aux agents de chercher des informations sur internet ou dans des bases de données internes.

- Exécuteurs de requêtes SQL : Pour accéder et manipuler des données dans des bases de données.

- API de traduction et de conversion : Pour traduire du texte ou convertir des unités.

2. Outils d'extension des capacités

- Calculatrices et interprètes de code : Pour effectuer des calculs complexes ou exécuter du code.

- Convertisseurs de devises et d'unités : Pour convertir des devises ou des unités de mesure.

3. Outils d'action d'écriture

- API d'email et de messagerie instantanée : Pour envoyer des messages.

- API bancaire : Pour effectuer des transactions financières.

4. Modèles de langage avancés

- Interpréter les requêtes des utilisateurs : Les LLM permettent aux agents de comprendre les questions posées en langage naturel.

- Générer des réponses contextuelles : Ils peuvent produire des réponses adaptées en fonction des informations disponibles et du contexte.

5. Outils d'accès aux données

- Moteurs de recherche : Pour récupérer des informations pertinentes sur internet.

- Bases de données : Les agents peuvent interroger des bases de données internes ou externes pour obtenir des données spécifiques.

- API : Les interfaces de programmation d'application permettent aux agents d'interagir avec d'autres systèmes et services pour collecter ou envoyer des données.

6. Outils d'analyse et de traitement

- Outils d'analyse de données : Ces outils aident à interpréter les données, à identifier des tendances et à prendre des décisions éclairées.

- Calculatrices et logiciels statistiques : Pour effectuer des calculs complexes ou analyser des ensembles de données.

7. Frameworks d'agents IA

- Botpress : Une plateforme qui permet de créer facilement des agents conversationnels avec un design visuel et un support multi-canal.

- LangGraph : Un framework open-source qui simplifie la création de workflows complexes avec une gestion d'état intégrée.

- CrewAI : Conçu pour orchestrer plusieurs agents travaillant ensemble, ce framework permet une collaboration intelligente entre agents.

8. Outils d'automatisation

- Systèmes de gestion de workflow : Pour orchestrer les tâches entre différents agents ou systèmes.

- Outils d'automatisation marketing : Pour gérer les campagnes marketing en ligne en fonction des interactions avec les clients.

9. Évaluation et Amélioration Continue

- Boucles de rétroaction : Les agents collectent des données sur leurs performances et ajustent leurs actions en conséquence.

- Supervision humaine : Dans certains cas, une intervention humaine est nécessaire pour valider les décisions prises par l'agent, garantissant ainsi une meilleure précision.

Vue d’ensemble de la planification

- Analyser toutes les sorties de films des cinq dernières années, puis filtrer ceux qui ont obtenu les meilleures notes ou les plus grands succès au box-office.

- Identifier d’abord les films ayant dépassé un certain seuil de popularité ou de critiques positives, puis analyser leurs caractéristiques.

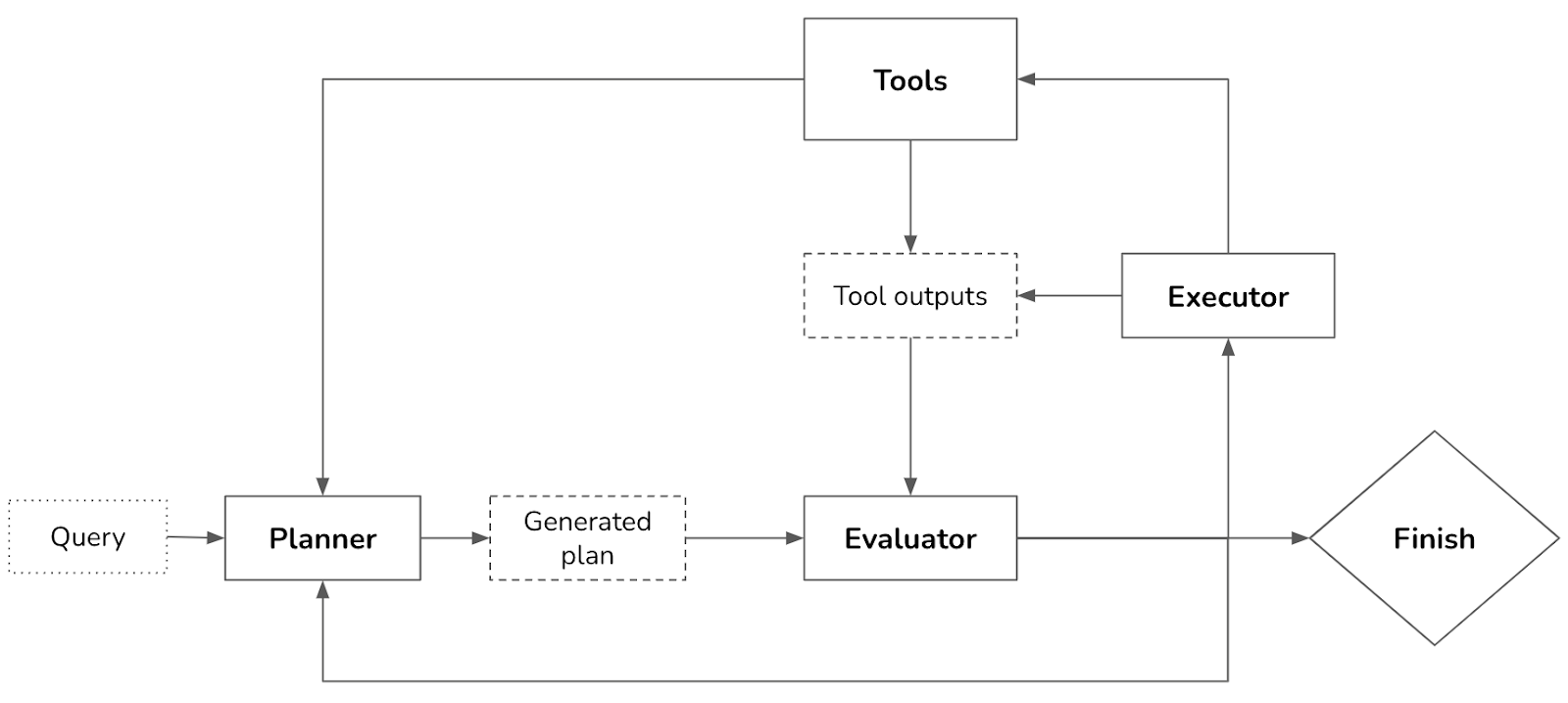

Séparer la planification et l’exécution

Validation du plan

- Rejeter les plans contenant des actions invalides (ex. : un plan nécessitant une recherche Google alors que l’agent n’a pas accès à Google).

- Éliminer les plans comportant un nombre excessif d’étapes.

Exemple d’implémentation en Python

Approche multi-agents et parallélisation

- Génération du plan

- Validation du plan

- Exécution du plan

- Si la requête concerne la facturation, l’agent doit accéder aux paiements récents.

- Si elle concerne la réinitialisation d’un mot de passe, il doit consulter la documentation.

Niveau d’automatisation et intervention humaine

Résumé du processus de planification

- Génération du plan : Décomposition de la tâche en sous-actions exécutables.

- Validation et correction : Vérification de la faisabilité et ajustement du plan si nécessaire.

- Exécution : Appel des fonctions nécessaires pour accomplir la tâche.

- Évaluation finale : Vérification des résultats et correction d’éventuelles erreurs.

Les modèles fondationnels en tant que planificateurs

La planification comme un problème de recherche

Différences entre planificateurs basés sur modèles fondationnels (FM) et apprentissage par renforcement (RL)

- Agents RL : leur planificateur est entraîné via un algorithme d’apprentissage par renforcement. Ce processus demande beaucoup de temps et de ressources.

- Agents FM : le modèle lui-même sert de planificateur. Il peut être amélioré via du prompt engineering ou un fine-tuning, nécessitant généralement moins de temps et de ressources.

Génération de plans

Prompt système

- getcurrenttime()

- fetchtodolist()

- fetchcalendarevents(startdate, enddate)

- generatetasksummary(taskhistory, tooloutput)

- generate_response(summary)

Exemples de requêtes et plans générés

Comprendre la structuration des plans

getcurrenttime() et obtient la date "2025-03-06", il peut ensuite ajuster les paramètres de l’étape suivante :- Combien d’événements doivent être affichés ?

- Quelle est la période concernée (aujourd’hui, cette semaine, ce mois-ci) ?

Éviter les erreurs dans la génération de plans

- Hallucinations d’actions : l’agent peut appeler une fonction inexistante.

- Mauvais paramètres : une fonction valide peut être appelée avec des valeurs incorrectes.

- Améliorer le prompt système en fournissant davantage d’exemples.

- Mieux décrire les outils et leurs paramètres pour éviter les erreurs d’interprétation.

- Réécrire les fonctions pour les rendre plus simples (ex. : décomposer une fonction complexe en plusieurs sous-fonctions).

- Utiliser un modèle plus puissant, car les modèles avancés génèrent généralement de meilleurs plans.

- Affiner le modèle (fine-tuning) sur des exemples spécifiques de planification.

Exécution des fonctions et appel d’outils (Function Calling)

- Créer un inventaire d’outils : déclarer les fonctions accessibles, leurs paramètres et leur documentation.

- Définir les outils disponibles pour chaque requête :

- required : l’agent doit utiliser au moins un outil.

- none : l’agent ne doit utiliser aucun outil.

- auto : l’agent décide quels outils utiliser.

lbstokg(lbs=40) et fournit la réponse finale à l’utilisateur.Granularité de la planification

- Un plan annuel (niveau macro) peut être divisé en plans trimestriels, puis en plans mensuels.

- Un plan détaillé est plus difficile à générer, mais plus facile à exécuter.

- Un plan global est plus facile à créer, mais plus complexe à exécuter.

- Générer un plan global.

- Détailler chaque étape à un niveau plus précis.

get_time() est renommée getcurrenttime(), tous les prompts et exemples devront être mis à jour.Exécution avancée des plans

- Exécution parallèle : plusieurs actions sont exécutées en même temps pour gagner du temps.

- Exécution conditionnelle (if statement) : une action est exécutée en fonction des résultats précédents.

- Boucles (for loop) : une action est répétée jusqu’à atteindre un objectif.

- Séquentiel : Vérifier l’agenda → Filtrer les réunions importantes → Générer un résumé.

- Parallèle : Récupérer l’agenda et la liste des tâches en même temps, puis les fusionner.

- Conditionnel : Si un créneau libre est détecté, proposer un rendez-vous ; sinon, suggérer des alternatives.

- Boucle : Analyser les événements jusqu’à trouver un créneau libre.

Conclusion

- Bien définir les outils disponibles et leurs paramètres.

- Utiliser des approches hybrides combinant structuration en langage naturel et appels de fonctions.

- Adopter une exécution dynamique permettant l’adaptation en fonction des résultats intermédiaires.

Choisir les bons outils pour un agent IA

- Certains modèles IA sont entraînés avec un nombre limité d’outils et doivent être optimisés pour fonctionner avec ces derniers.

- D’autres systèmes intègrent des bibliothèques très larges et nécessitent une gestion intelligente des ressources pour éviter une surcharge.

- Un modèle doit comprendre et choisir le bon outil au bon moment.

- Trop de descriptions d’outils peuvent dépasser la capacité de contexte du modèle.

- Un agent trop chargé en outils peut devenir inefficace et faire plus d’erreurs.

Comment optimiser le choix des outils ?

- Tester différentes combinaisons d’outils : observer comment l’agent se comporte avec des ensembles variés et ajuster en conséquence.

- Évaluer l’impact de chaque outil : supprimer un outil et voir si la performance de l’agent diminue. Si ce n’est pas le cas, cet outil est probablement inutile.

- Identifier les outils problématiques : si un agent fait fréquemment des erreurs en utilisant un outil, il faut soit optimiser son apprentissage, soit remplacer l’outil.

- Analyser la fréquence d’utilisation des outils : repérer ceux qui sont les plus sollicités et ceux qui sont rarement utilisés.

Différents agents, différents besoins

- Un agent d’assistance technique nécessitera des outils d’accès à une base de connaissances et des API de diagnostic.

- Un agent de trading automatisé privilégiera des API financières et des outils de prévision de tendances.

- Un assistant en cybersécurité devra intégrer des outils d’analyse de vulnérabilités et de détection d’anomalies.

- Certains frameworks sont spécialisés dans les outils de réseaux sociaux (Twitter, Reddit, LinkedIn).

- D’autres sont optimisés pour les applications professionnelles (Google Workspace, Microsoft 365, GitHub).

Conclusion : L'essor des agents IA autonomes

- Optimisation de la planification et de l’exécution : Séparer ces deux étapes permet d’éviter des erreurs et d’optimiser les performances.

- Choix des outils adaptés : Un bon équilibre entre diversité et pertinence des outils est essentiel pour éviter une surcharge cognitive du modèle.

- Adaptabilité et robustesse : Les agents doivent être capables d’apprendre de leurs erreurs, de s’adapter à de nouveaux environnements et d’évoluer avec le temps.

- Intervention humaine et contrôle : L’IA ne doit pas fonctionner en vase clos. Une supervision humaine reste essentielle pour certaines tâches critiques.

Vers des agents IA toujours plus puissants

Partager avec

💙 Merci d'avoir parcouru l'article jusqu'à la fin !

Aicha Bouchti - Ingénieur de formation

Ingénieur de formation avec plus de 6 ans d'expérience dans le développement back-end et le data engineering. Expert dans l’industrialisation des projets data dans le cloud.

» En savoir plus

Articles associés

Voir tous nos articles →

janvier 17, 2025

Devin AI : L’intelligence artificielle au service des professionnelsTemps de lecture : 2 min

mars 6, 2025

Taskade : L’application qui révolutionne la gestion de projets en équipeTemps de lecture : 2 min

mars 16, 2025

Développement 10x plus rapide ? Blackbox AI révolutionne le coding avec l’IA !Temps de lecture : 2 min

mars 19, 2025

Un doute ? Une question ? Question AI vous répond en quelques secondes !Temps de lecture : 1 min

mars 26, 2025

n8n propulse l’automatisation IA : zoom sur une levée stratégique de 60M$Temps de lecture : 3 min

avril 3, 2025

Amazon Nova Act : L’IA qui navigue pour vous — et ce n’est que le début !Temps de lecture : 2 min

avril 16, 2025

Operator par OpenAI : l’IA qui clique, remplit, réserve et agit à votre place !Temps de lecture : 2 min

Formations associés

Toutes nos formations →

DataScientist.fr

By AXI Technologies

La certification qualité a été délivrée au titre des catégories d’actions suivantes :

- Actions de formation

Consulter le certificat© 2026 DataScientist.fr - AXI Technologies - Tous droits réservés