Collection

Aucun article trouvé dans cette collection.

Qu’est-ce que l’IA générative ? Guide complet 2025

Table de matières

1. Qu’est-ce que l’IA générative ?

2. Comment fonctionne l’IA générative ?

3. Panorama 2025 des modèles de génération

4. Cas d’usage concrets en entreprise

5. Limites et risques à connaître

6. Régulation et éthique de l’IA en 2025

7. Comment choisir un modèle ou service d’IA ?

8. Ressources utiles et outils recommandés

9. Conclusion

Partager avec

1. Qu’est-ce que l’IA générative ?

Une définition technique et concrète

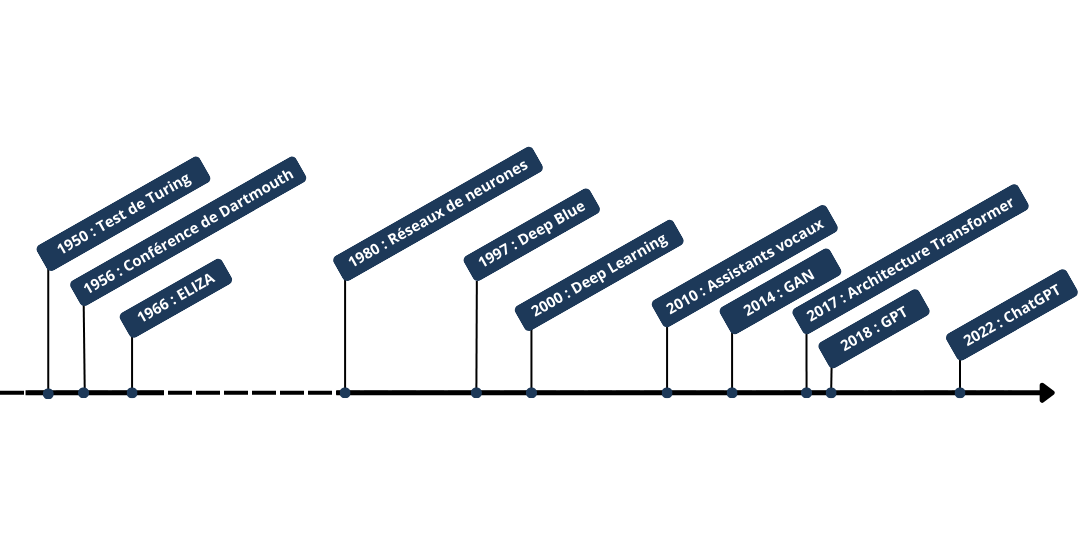

Origines et évolution de 2014 à 2025

2014 – L’invention des GANs : Les Generative Adversarial Networks (réseaux adverses génératifs) ont été introduits par Ian Goodfellow. Ces réseaux en duel — un générateur et un discriminateur — ont permis la création d’images réalistes à partir de bruit aléatoire.

2017 – L’architecture Transformer : L’article Attention is All You Need a marqué une rupture. Cette architecture a permis des performances spectaculaires dans la génération de texte, et est aujourd’hui la base de tous les grands modèles (GPT, BERT, Claude...).

2022–2025 – Démocratisation via ChatGPT & modèles multimodaux : OpenAI a révélé ChatGPT en novembre 2022, rendant l’IA générative accessible à tous. Depuis, l’écosystème s’est étoffé avec Claude, Gemini, Mistral, et l’intégration de la multimodalité (texte + image + son).

2. Comment fonctionne l’IA générative ?

Transformers, diffusion et experts : architectures clés

Transformers : utilisés pour le texte et la multimodalité. Leur mécanisme central, l’attention multi-têtes, permet d’analyser le contexte d’une phrase en parallèle. C’est l’architecture de base des modèles GPT, Claude ou Gemini.

Modèles de diffusion : utilisés pour les images et l’audio. Ils apprennent à débrouiller des données bruitées pour recréer du contenu fidèle à un style ou un thème (ex. : Stable Diffusion, DALL·E 3).

Mixture-of-Experts (MoE) : une nouvelle approche « sparse » dans laquelle seuls quelques experts spécialisés sont activés à chaque étape.

Fine-tuning, RLHF et RLAIF : aligner les modèles

RLHF (Reinforcement Learning from Human Feedback) : des humains notent les réponses, un modèle de récompense est formé, puis le LLM est affiné via PPO.

RLAIF (Reinforcement Learning from AI Feedback) : une IA critique une autre IA. Méthode scalable et moins coûteuse.

RAG et bases de connaissances externes

Une requête est transmise à un moteur de recherche (ex. : Kendra, Elastic, LlamaIndex).

Le résultat est injecté dans le prompt du LLM.

L’IA peut répondre avec un contexte à jour et documenté.

« Explique-moi simplement comment fonctionne un modèle GPT. »

« Quelle est la différence entre RLHF et RLAIF ? »

« Quels sont les avantages du RAG pour éviter les hallucinations ? »A

3. Panorama 2025 des modèles de génération

Grands modèles fermés

GPT-4o (OpenAI) : modèle multimodal avec 128 000 tokens de contexte, très performant sur tous les benchmarks (88,7 % sur MMLU).

Claude 3 (Anthropic) : basé sur l’AI constitutionnelle, conçu pour être éthique, sûr et robuste.

Gemini 2.5 Pro (Google DeepMind) : gestion de contextes massifs jusqu’à 2M tokens, génération vocale et visuelle avancée.

Modèles open-source

LLaMA 3.1 (Meta) : jusqu’à 405B paramètres, open source, multilingue.

Mixtral 8×7B : très bon équilibre entre qualité, coût et accessibilité.

Phi-3 Mini (3,8B) : déployable localement, performant malgré sa petite taille.

Comparatif coûts / performances

| Modèle | Score MMLU | Contexte | Prix approx. |

|---|---|---|---|

| GPT-4o | 88.7 % | 128k | $15/M sortie |

| Claude 3 | ~85 % | 100k | $12/M estimé |

| Gemini 2.5 Pro | 82 % | 1M | $21/M sortie |

| Mistral Large | 81.2 % | 32k | $2/M entrée, sortie gratuite |

| Mixtral | ~75 % | 32k | open-source |

| LLaMA 3 70B | ~83 % | 128k | open-source |

| Phi-3 Mini | ~70 % | 16k | local (CPU/edge) |

4. Cas d’usage concrets en entreprise

Marketing, service client, R&D, IT...

Marketing digital : automatisation de la rédaction de posts, newsletters, pages produits. Outils comme Jasper ou Copy.ai permettent d’adapter le ton à chaque cible.

Relation client : des assistants comme ceux d’Orange ou de La Poste gèrent jusqu’à 60 % des demandes simples, en multilingue, avec une fluidité proche de l’humain.

Développement logiciel : GitHub Copilot génère plus de 40 % du code chez certains éditeurs SaaS. D’autres entreprises forment des modèles internes pour leur code legacy.

Design et création : Midjourney, DALL·E ou Firefly (Adobe) sont utilisés pour prototyper rapidement des visuels, créer des moodboards, ou explorer des concepts de produit.

Finance et reporting : l’IA génère des synthèses, des commentaires de performance ou même des rapports financiers (ING, BNP Paribas).

Focus France : Sanofi, Airbus, Carrefour, BNP Paribas

Sanofi : avec son outil GenAIr, la rédaction de rapports qualité industriels est passée de 120 h à 15 h.

Airbus : mise en œuvre de modèles RAG pour donner des réponses précises aux techniciens et équipes qualité.

Carrefour : intégration d’un assistant IA dans les points de vente pour aider les directeurs magasin à ajuster les rayons selon la demande locale.

BNP Paribas : gestion d’un portefeuille de 780 cas d’usage IA, dont plusieurs à base générative (rapports, aide à l'analyse réglementaire, assistants internes).

Gains mesurables : productivité, qualité, réduction des coûts

Réduction du temps de production de contenu (×2 à ×10 selon les cas).

Amélioration de la personnalisation client (segmentation + copywriting dynamique).

Gain de temps de diagnostic IT ou maintenance (ex. : Air France).

Automatisation de tâches internes répétitives (résumés de réunions, suivis qualité…).

5. Limites et risques à connaître

Biais, hallucinations, fuites de données, détournement

Hallucinations : même les modèles les plus avancés peuvent inventer des références, faux chiffres, ou interpréter à tort des consignes.

Biais discriminatoires : les modèles reproduisent les stéréotypes présents dans leurs données d’entraînement (genre, race, âge…).

Prompt injection / Jailbreak : des attaques malveillantes permettent parfois de contourner les filtres de sécurité pour extraire des informations sensibles ou générer du contenu interdit.

Confidentialité : lorsqu’un utilisateur copie-colle du contenu sensible dans un chatbot en ligne, celui-ci est parfois traité sans contrôle. Cas emblématique : Samsung en 2023.

Empreinte écologique et coûts de calcul

Modèles MoE (plus légers en inférence)

Quantization & distillation

Déploiement local pour limiter les appels réseau

6. Régulation et éthique de l’IA en 2025

AI Act européen : principes et niveaux de risque

Risque inacceptable (ex. : notation sociale, manipulation cognitive)

Risque élevé (ex. : recrutement, santé, éducation)

Risque limité (ex. : chatbots informatifs)

Risque minimal (ex. : filtres anti-spam)

Rôle de la CNIL et obligations en France

Création d’un service dédié IA

Renforcement des contrôles RGPD sur les traitements IA

Focus spécifique sur la protection des mineurs

Sensibilisation des entreprises aux obligations du AI Act

Autocontrôle et IA responsable en entreprise

Comités éthiques IA

Cartographie des risques

Audit de biais algorithmique

Labels internes de conformité

7. Comment choisir un modèle ou service d’IA ?

Critères : coût, contrôle, capacité, langue, déploiement

- Capacité : volume de tokens, support multilingue, performance sur vos tâches cibles (résumé, création, classification…).

- Contrôle : avez-vous besoin d’un modèle auto-hébergé ? d’un modèle auditable ?

- Langues supportées : les modèles comme GPT-4o, Claude 3 ou Mistral sont performants en français.

- Budget : GPT-4 coûte jusqu’à 15$/M tokens sortants, contre 0 pour Mixtral auto-hébergé.

- Confidentialité :

- modèles open-source = contrôle total.

- API = dépendance à un tiers.

Cloud vs local : quel hébergement ?

- API cloud (SaaS) : OpenAI, Anthropic, Google. Facile à intégrer, mais avec des coûts récurrents et une dépendance réglementaire (RGPD, hébergement hors UE).

- Self-hosted : Mixtral, LLaMA, Phi-3. Plus complexe techniquement mais excellent pour le traitement de données sensibles ou la personnalisation profonde.

API, open-source, solution clé en main

- Hugging Face : hub de modèles + API d’inférence.

- Mistral API : accès simple aux modèles via Azure EU.

- LangChain, LlamaIndex : frameworks pour construire rapidement des assistants IA augmentés.

- "Quel modèle IA open source me conseillez-vous pour résumer des PDF juridiques ?"

- "Quelle API IA utiliser pour mon chatbot multilingue ?"

- "Quels modèles sont disponibles en hébergement européen ?"

8. Ressources utiles et outils recommandés

Formations, benchmarks, bases de données, comparateurs

- Formations :

- DeepLearning.ai (Andrew Ng)

- DataScientist.fr

- Hugging Face Learn

- Benchmarks :

- HELM (Holistic Evaluation of Language Models)

- MT-Bench (LMSYS)

- Open LLM Leaderboard (Hugging Face)

- Comparateurs :

- lmsys.org

- AIarena

- huggingface.co/spaces/

- Bases de connaissances RAG :

- Arxiv

- PubMed

- CNIL

- jurisprudence.gouv.fr

Liens utiles : CNIL, OpenAI, Hugging Face, DeepMind...

- CNIL : https://www.cnil.fr

- OpenAI : https://openai.com

- Mistral AI : https://mistral.ai

- Hugging Face : https://huggingface.co

- Google DeepMind : https://deepmind.google

9. Conclusion

Ce qu’il faut retenir sur l’IA générative en 2025

- L’IA générative est devenue un outil stratégique.

- Elle transforme les métiers du marketing, de l’IT, de la finance, de la logistique.

- Il existe des alternatives open-source robustes, comme Mixtral ou LLaMA 3.

- La régulation progresse : AI Act, CNIL, politiques d’audit internes.

Partagez ce guide et interrogez nos experts

FAQ

Prenez un moment pour discuter de votre projet de formation avec un conseiller.

Réponse :

Réponse :

Réponse :

Réponse :

Réponse :

Réponse :

Réponse :

Réponse :

Partager avec

💙 Merci d'avoir parcouru l'article jusqu'à la fin !

Romain DE LA SOUCHÈRE

Lead Developer, Expert Cloud et DevOps

Romain DE LA SOUCHERE est un ingénieur passionné par la data et l’innovation. Après plus de 11 ans d’expérience, dont plusieurs années comme Lead Developer sur des solutions Smart Building à haute performance, il a rejoint Formations Certifiantes en Data Science, IA & Azure | DataScientist.fr pour transmettre son savoir-faire en data engineering, cloud Azure et IA générative.

» En savoir plusArticles associés

Voir tous nos articles →

septembre 23, 2024

Comment la normalisation des données améliore les performances des modèles d'apprentissage automatiqueTemps de lecture : 5 min

Formations associés

Toutes nos formations →